Por qué es tan peligroso que Siri, Alexa o Google Assistant estén siempre escuchándonos

¿Tienes un altavoz inteligente? ¡Cuidado con los vídeos de YouTube, canciones o sonidos extraños! Hackearlo es así de fácil.

Hace unas semanas os contábamos un divertido y a la vez tétrico suceso en el que Alexa, el asistente virtual de Amazon y sus altavoces inteligentes, se ponía a hablar en medio de la noche con el consecuente susto para sus dueños. Con los asistentes virtuales, es lo que tiene.

No puedes evitar que hackeen tu altavoz inteligente, ¡ni siquiera puedes oírlo!

Y es que con un dispositivo atento las 24 horas del día, cualquier cosa puede actuar como gatillo que lo active. Pues bien, mientras que eso era un fallo de fabrica, unos investigadores acaban de descubrir una peligrosa forma de hackear asistentes de voz delante de los usuarios sin que estos se percaten, como leemos en Daily Mail.

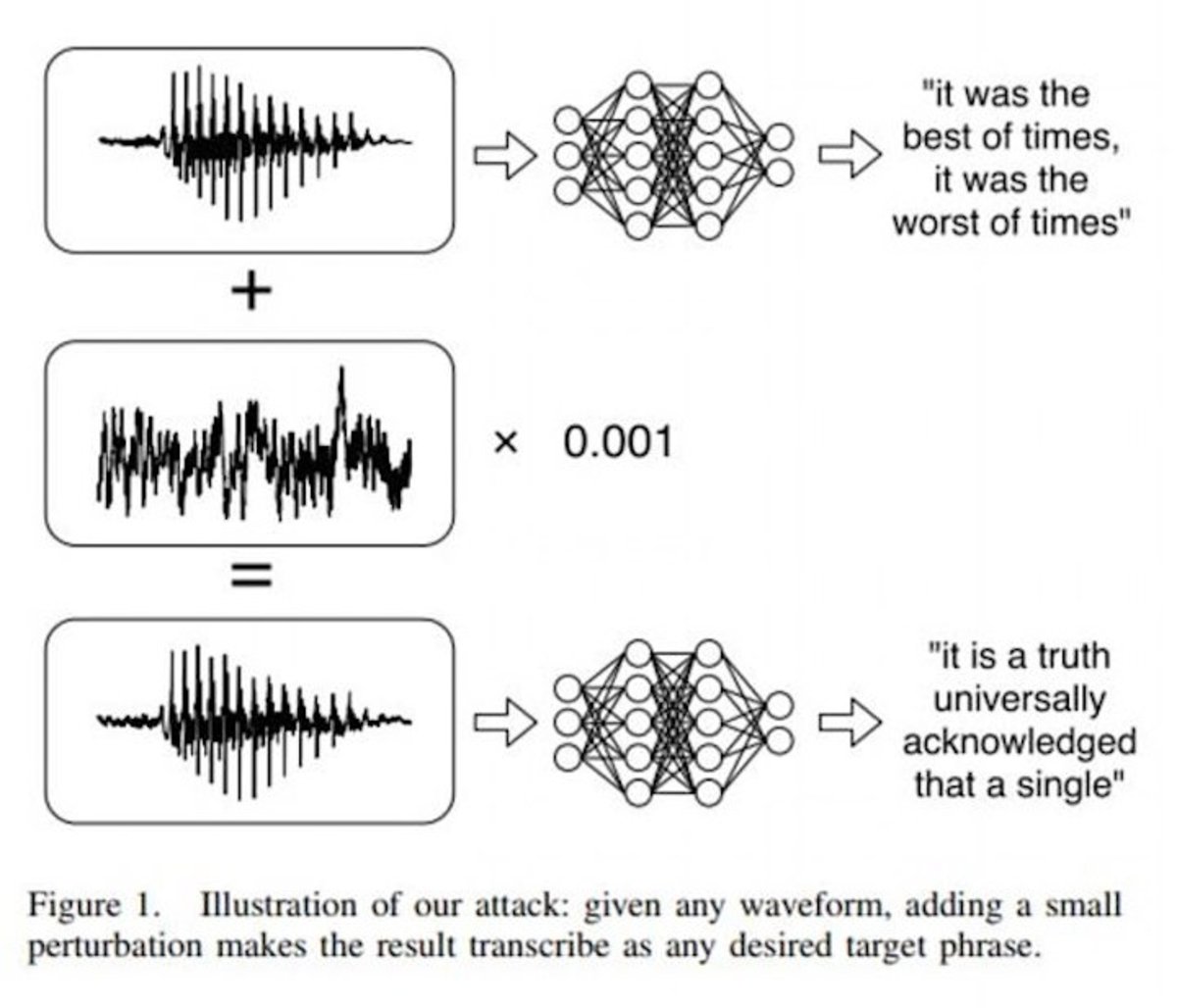

Lo único necesario son unos comandos secretos que hay que decir en voz alta. ¿Cómo lo consiguen? Ocultándolo dentro de una pieza musical, un vídeo de YouTube o simplemente ruido ambiental... Siri, Alexa o Google Assistant lo escucharán y ya habrán caído en la trampa: tu altavoz inteligente ha sido secuestrado en un abrir y cerrar de ojos.

Lo peor es que no hay forma humana (literalmente) de darse cuenta, ya que son imperceptibles para nuestros oídos, así que no hay nada que podamos hacer para evitarlo.

Ocultar mensajes en música o vídeos es más fácil y barato de lo que crees. Daily Mail

Afortunadamente, esta vulnerabilidad se ha detectado en un laboratorio de la Universidad de Berkeley (California), pero no se ha reportado hasta la fecha un hackeo de smart speakers siguiendo esta técnica.

Sin embargo, es cuestión de tiempo que esta pesadilla se haga realidad. A día de hoy, el uso de altavoces inteligentes todavía no está muy extendido, pero conforme se hagan más populares, la brecha de seguridad está ahí para ser atacada, según el New York Times.

Como explican estos investigadores: da igual que te compres un HomePod, un altavoz de Amazon o cualquiera de los dispositivos de diferentes marcas que integran Google Assistant, todos ellos son susceptibles de sufrir este ataque.

De acuerdo con el estudio:

Con una onda sonora arbitraria cualquiera como la música, podemos envolver un mensaje en un audio que no se reconoce como voz, pudiendo ocultar el audio de un sistema de voz que puede traducirse en texto y viceversa.

Estos comandos secretos pueden conseguir que el asistente de voz haga todo tipo de cosas: tomar fotografías, enviar mensajes de texto, abrir páginas web e incluso llamadas de teléfono sin el consentimiento de sus usuarios originales.

Y no es la primera vulnerabilidad detectada, este dudoso privilegio es para el dolphin attack o ataque delfín, descubierta por unos científicos de la Universidad de Zhejiang, en China.

¿Qué es dolphin attack?

El pasado septiembre estos investigadores publicaron un estudio sobre la técnica dolphin attack o ataque delfín. Con ella, es posible descargar un virus, enviar mensajes falsos o incluso añadir eventos falsos al calendario.

Como en el estudio de Berkeley, ellos emplearon una técnica que convertía los comandos de voz en frecuencias ultrasónicas que son demasiado altas para el oído humano, haciéndolas inaudibles.

Hackear un altavoz inteligente es muy rápido y barato

Pero que nosotros no podamos oírlas no significa que no estén actuando: el micrófono nuestro altavoz inteligente las capta y las interpreta. El equipo de investigadores fue capaz de lanzar ataques a más de 20 kHz usando un equipo valorado en unos tres dólares. Es decir, que invirtiendo menos de tres euros puedes hackear altavoces inteligentes mucho más caros y que dan acceso a información personal sensible y valiosa.

Solo hace falta un smartphone normal y corriente (ellos usaron un Samsung Galaxy S6 Edge), una batería externa, un amplificador y un convertidor de ultrasonidos.

¿Cómo harán frente Amazon, Apple y Google a la amenaza?

Aunque todavía no es una amenaza real, si todo sigue así, será cuestión de tiempo que los altavoces inteligentes se conviertan en chivatos de lo que sucede en casa.

Con estos estudios, los investigadores pretenden alertar a los fabricantes para evitar que esta vulnerabilidad se convierta en una práctica común. Como explica Nicholas Carlini, director del estudio, al Times:

Queremos demostrar que es posible y esperamos que las personas adecuadas se den cuenta y hagan algo para arreglarlo.

Por el momento, Amazon insiste en que ha tomado medidas de seguridad extra para asegurarse de que Echo es seguro. Por su parte, Google ha explicado que ha implementado una serie de funciones para mitigar los comandos de audio indefectibles. El HomePod de Apple tiene integradas unas características de seguridad adicionales para evitar que su altavoz inteligente abra puertas y requiere a los usuarios una autenticación extra para funciones como desbloquear el iPhone o acceder a datos sensibles.