La generación Z ha encontrado en ChatGPT un psicólogo asequible disponible 24/7. Los terapeutas aseguran que es peligroso

La generación Z, también conocida como la generación de los centennials o zoomers, engloba a las personas nacidas entre mediados o finales de la década de 1990 hasta finales de la década de los 2000 o principios de la siguiente. Se caracteriza por haber usado desde joven Internet, sintiéndose cómoda generalmente con la tecnología y las redes sociales.

Haber crecido con smartphones, Facebook, Twitter y una sobrecarga constante de información tenía que pasar factura de algún modo; diversos estudios internacionales y regionales aseguran que la generación Z se enfrenta a tasas más altas de ansiedad, depresión, estrés y pensamientos suicidas respecto a generaciones anteriores a su misma edad.

Una encuesta del año 2023 de Deloitte (firma global de servicios profesionales que ofrece una amplia gama de servicios, como auditoría, consultoría, asesoría financiera, gestión de riesgos y servicios fiscales) reveló que casi la mitad de los trabajadores de la generación Z sufre estrés y ansiedad laboral la mayor parte del tiempo. Con el auge de la inteligencia artificial, muchos de ellos han encontrado en ChatGPT un terapeuta accesible las 24 horas del día, por mucho menos de lo que cuesta uno de carne y hueso.

Usar ChatGPT como psicólogo no es una muy buena idea

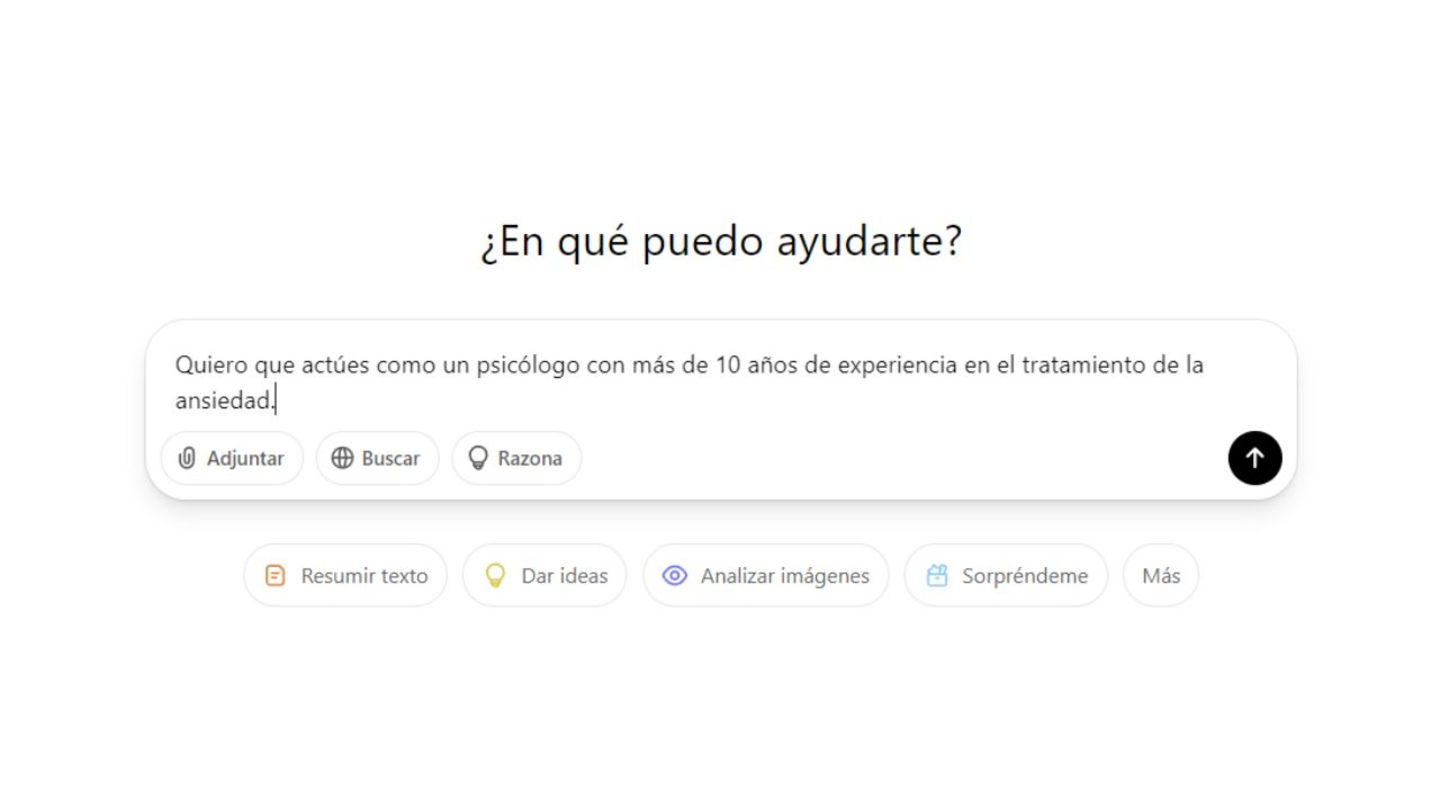

Pidiendo a ChatGPT que actúe como psicólogo con mucha experiencia en el tratamiento de la ansiedad

El precio de una sesión con un psicólogo en España varía dependiendo del tipo de terapia, la experiencia del profesional y la ubicación geográfica. A grandes rasgos, se podría estimar que una sesión de 45 minutos cuesta entre 45 y 80 euros, aunque podría superar los 100 euros si es alguien muy experimentado.

La suscripción Plus de ChatGPT sale por 23 euros al mes, aumentando el límite de mensajes y carga de archivos, además de dar acceso al modo de voz avanzada y a probar varios modelos de razonamiento, entre otras funciones. Por unos 20 euros menos de lo que cuesta una sesión con un psicólogo económico, dispones las 24 horas del día, los 7 días de la semana, de un bot conversacional que se «puede» convertir en uno.

Cada vez más usuarios utilizan la tecnología desarrollada por OpenAI para tratar sus problemas. Sin embargo, los profesionales de la salud mental no lo recomiendan, asegurando que hay innumerables inconvenientes para el ámbito terapéutico. De hecho, un portavoz de OpenAI ha afirmado en una declaración a Fortune que ChatGPT suele recomendar a los usuarios que busquen asesoramiento profesional, y que según sus términos de servicio no debería sustituirlo.

Un testimonio de un usuario de Reddit se ha hecho viral en Internet. La persona, cuya identidad es anónima, asegura que el bot conversacional le había ayudado más que "15 años de terapia". A pesar de haber tenido diversas experiencias con varios profesionales, las charlas diarias con ChatGPT fueron lo que más le ayudaron a abordar sus problemas de salud mental.

No sé ni cómo explicar cuánto ha cambiado esto mi vida. Me siento apoyado. He hecho más progresos en unas pocas semanas que en varios años de terapia tradicional.

Este no es el único usuario que ha utilizado el chatbot como terapeuta. Otro comentó que "Me encanta ChatGPT como terapia. No proyecta sus problemas en mí. No abusa de su autoridad. Está dispuesto a hablar conmigo a las 23:00 horas". Otros comentaristas apoyaron la idea de usar la IA como profesional de la salud mental, asegurando que incluso la versión más avanzada de 200 dólares al mes seguía siendo una ganga.

Alyssa Petersel, trabajadora social clínica colegiada y directora ejecutiva de MyWellbeing, afirma que la IA como terapeuta puede tener sus inconvenientes, pero que puede ser útil cuando se combina con terapia tradicional. Sin embargo, confiar ciegamente en un bot conversacional en situaciones estresantes puede perjudicar la capacidad de las personas para afrontar los problemas por sí misma.

Por otro lado, hay gente que acaba creando vínculos emocionales con las inteligencias artificiales de los bots conversacionales, dejando de ser objetivos. Esto ha despertado las preocupaciones sobre las medidas de seguridad, especialmente en los menores de edad. Sewell Setzer, de 14 años, se suicidó después de entablar una conversación con la plataforma de IA Character.ai