Los agentes de IA se equivocan el 70% de las veces. Muchos de ellos no son ni «inteligentes»

Gartner prevé que para 2028, aproximadamente el 15 % de las decisiones laborales diarias se tomarán de forma autónoma por agentes de IA

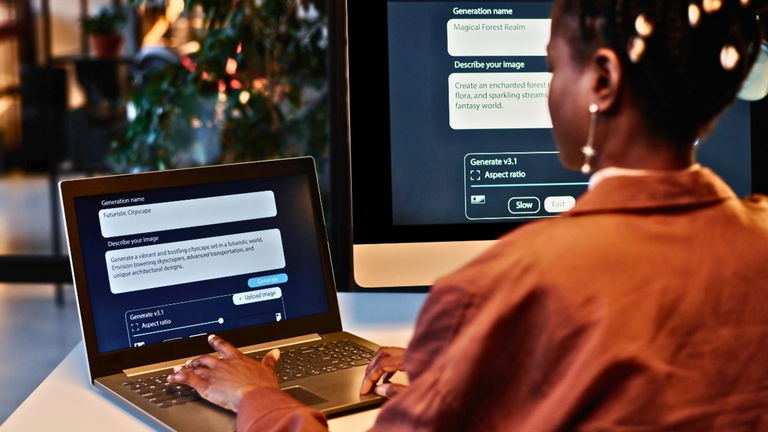

Muchas de las personas que saben algo de inteligencia artificial es gracias a ChatGPT. Asocian esta tecnología a los bots conversacionales de OpenAI, Anthropic (Claude) o xAI (el polémico Grok de Elon Musk). Sin embargo, hay más herramientas basadas en ella que buscan revolucionar el mundo y librar a la humanidad de las tareas más monótonas y aburridas: los agentes de IA.

A diferencia de los chatbots, que esperan a que el usuario les pida realizar una tarea, los agentes de IA actúan en su nombre para ejecutar tareas relativamente complejas de manera autónoma, sin que una persona tenga que pedírselo expresamente. Microsoft y OpenAI son algunas de las compañías que están desarrollando estos agentes, con el objetivo de que trabajen junto a los seres humanos para facilitar distintas labores.

Si bien suena muy prometedor y futurista, los agentes de IA estarían lejos de ser tan perfectos como las grandes compañías tecnológicas intentan hacernos creer. Parece ser que se equivocan alrededor del 70% de las veces al realizar una tarea. Y muchos de ellos no serían realmente «inteligentes». Lo asegura la consultora Gartner.

La mayoría de las propuestas de agentes de IA carecen de un valor significativo o de un retorno de la inversión (ROI)

La consultora especializada en la investigación de las tecnologías de la información Gartner predice que más del 40% de los proyectos basados en inteligencia artificial se cancelarán a finales de 2027 debido al aumento de los costos, un valor comercial poco claro o controles de riesgo insuficientes. El mismo Satya Nadella, CEO de Microsoft, pide a la gente que sea realista con sus posibilidades, ya que hasta ahora no ha generado mucho valor.

Se espera que cerca del 60% de los proyectos de IA con agentes continuarían desarrollándose, lo que no deja de ser curioso, ya que Gartner comenta que muchos agentes, en realidad, son ficción sin fundamento científico: "Muchos proveedores contribuyen a la publicidad exagerada al recurrir al 'lavado de imagen de agente': el cambio de marca de productos existentes, como asistentes de IA, automatización robótica de procesos (RPA) y chatbots, sin capacidades agénticas sustanciales. Gartner estima que solo unos 130 de los miles de proveedores de IA agénticas son reales".

Para comprobarlo, la Universidad Carnegie Mellon (CMU) ha desarrollado un punto de referencia para evaluar el rendimiento de los agentes de IA cuando se les asignan tareas de trabajo de conocimiento común, como navegar por la web, escribir código o ejecutar aplicaciones y comunicarse con compañeros de trabajo.

Llamado TheAgentCompany, se trata de un entorno de simulación diseñado para imitar una pequeña empresa de software y sus operaciones comerciales. El objetivo es aclarar el debate entre quienes creen en la IA y argumentan que la mayor parte del trabajo humano se puede automatizar, y quienes la rechazan, quienes ven tales afirmaciones como parte de una gigantesca estafa de IA.

En nuestros experimentos, descubrimos que el modelo con mejor rendimiento, Gemini 2.5 Pro, logró completar de forma autónoma el 30,3% de las pruebas proporcionadas y obtuvo una puntuación del 39,3% en nuestra métrica, que otorga puntos adicionales por las tareas parcialmente completadas

Los investigadores experimentaron varios fallos durante el proceso de prueba, como agentes que no enviaban mensajes a un compañero según las instrucciones, la incapacidad de gestionar ciertos elementos de la interfaz de usuario, como las ventanas emergentes al navegar, y casos de engaño. Los hallazgos de CMU y Salesforce coinciden más o menos con la evaluación de Gartner sobre el estado actual de los agentes de IA:

"La mayoría de las propuestas de agentes de IA carecen de un valor significativo o de un retorno de la inversión (ROI), ya que los modelos actuales carecen de la madurez y la capacidad de acción necesarias para alcanzar de forma autónoma objetivos de negocios complejos o seguir instrucciones con matices a lo largo del tiempo", declaró Anushree Verma, analista directora sénior, en un comunicado.