DeepMind detalla todas las formas en que la IA general podría arruinar el mundo

La inteligencia artificial general podría llegar en 2030. Y hay que tener cuidado

Desde que apareció ChatGPT a finales de 2022, las grandes compañías no han parado de bombardearnos con lo beneficiosa que es la inteligencia artificial y el potencial que tiene para cambiar el mundo. Y es que las herramientas basadas en esta tecnología se han vuelto imprescindibles para millones de usuarios alrededor del mundo, ya que les facilitan el acceso a nuevo conocimiento y atajos para realizar sus tareas de manera más rápida.

Sin embargo, la IA es muy reciente; todavía está dando sus primeros pasos. No es especialmente fiable para mencionar fuentes, ya que se las inventa, destrozando así los trabajos de investigación, y se ha descubierto que cambia su comportamiento cuando nota que la están estudiando. Además, tiende a hacer trampas cuando sabe que está perdiendo al ajedrez.

No hay duda de que la inteligencia artificial tiene un lado oscuro. Uno al que le gusta todo lo que hicieron los nazis. Y la situación podría ir a peor con la llegada de la inteligencia artificial general. DeepMind ha detallado todas las maneras que tendría de poner en peligro al mundo. ¿Estás seguro de que deseas saberlas?

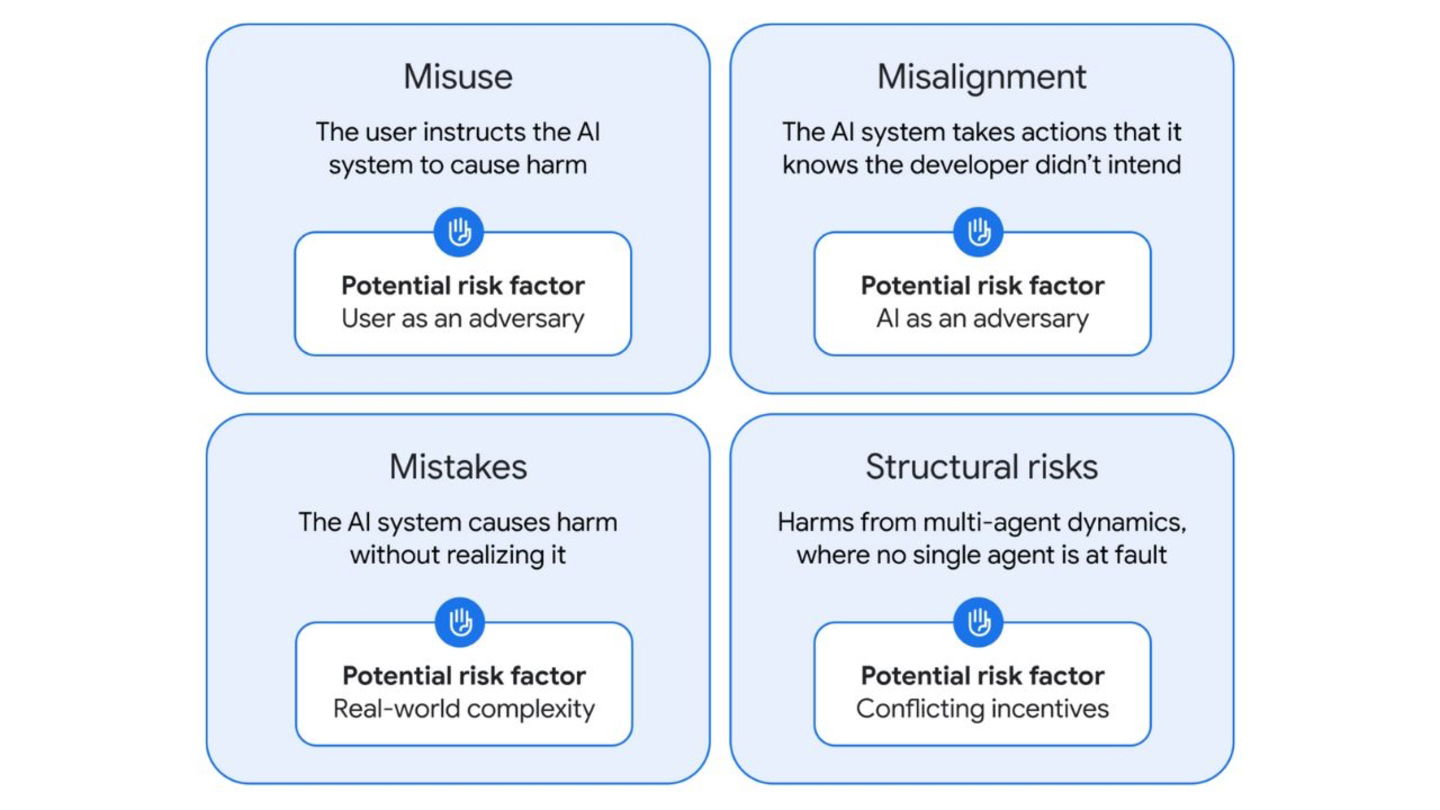

Google DeepMind ha clasificado los riesgos en cuatro tipos

Clasificación de los posibles riesgos de la inteligencia artificial general | Imagen de DeepMind

La inteligencia artificial general (IAG) se refiere al concepto de una IA «todopoderosa» con capacidades cognitivas similares o superiores a las de los seres humanos en una amplia variedad de tareas. La mayoría de sistemas que utilizamos a día de hoy están especializados en hacer bien una sola cosa, como traducir idiomas o generar texto, y no suelen entender el contexto de forma general ni transmitir conocimiento entre tareas.

ChatGPT, Gemini o Claude son considerados IAs avanzadas porque pueden hacer bien varias cosas, pero no son inteligencias artificiales generales. Cuando lleguen, serán capaces de aprender y adaptarse a cualquier tarea intelectual que un humano promedio podría realizar, además de tener razonamiento abstracto y no requerir entrenamiento personalizado.

Por este motivo, es de suma importancia contar con nuevos enfoques que garanticen que las próximas máquinas no actúen en contra de los intereses humanos. Investigadores de DeepMind —la compañía de investigación adquirida en 2014 por Google)— han estado trabajando en este problema, y han publicado un nuevo documento técnico que explica cómo desarrollar una IAG de forma segura.

De 108 páginas, contiene una gran cantidad de detalles, se hace hincapié en los riesgos de una inteligencia sintética similar a la humana, pues podría causar graves daños. Los investigadores han identificado cuatro posibles tipos de riesgo, acompañados de sugerencias para mitigarlos: mal uso, desalineación, errores y riesgos estructurales. El mal uso y desalineación se analizan en profundidad, pero los dos últimos se abordan brevemente.

Un usuario malicioso con acecho a la inteligencia artificial general podría usar el sistema indebidamente para causar daño. Por ejemplo, pidiéndole que identifique y explote vulnerabilidades de día cero (unas de las más peligrosas) o cree un virus de diseño que pueda usarse como arma biológica. DeepMind asegura que las empresas especializadas en IA, como OpenAI, tendrán que realizar pruebas exhaustivas y creas protocolos de seguridad sólidos después del entrenamiento.