Detectar imágenes falsas ya es posible gracias a Google

Cuando las herramientas para modificar imágenes son cada vez más inteligentes, debemos contraatacar con aplicaciones para detectarlas.

Los deepfakes aún no son un problema mayor, pero cada vez están más introducidos en nuestro día a día. Hasta ahora lo hemos visto y probablemente reconocido en en memes, vídeos de Internet (como uno donde introducen a Jim Carrey en 'El Resplandor') y en otro tipo de contenidos más serios (por ejemplo, donde Donal Trump declare la guerra a otro país). Pero pronto podría comenzar a usarse para otros fines como política, alcanzando un nivel de seriedad mayor. Por ello, gigantes como Google quieren estar preparados para cuando haya tantas imágenes y vídeos modificados que sea difícil reconocerlos.

Y el último avance publicado en este campo no es precisamente una Inteligencia Artificial para producir imágenes modificadas más reales, sino precisamente lo contrario: una de las incubadoras de Google ha presentado una aplicación capaz de identificar estos deepfakes.

El algoritmo per se no es capaz de detectar si una imagen ha sido modificada (al menos por ahora), sino que necesita de la ayuda humana. Aún así, este poderoso programa lo tiene todo para convertirse en una herramienta de verificación tanto para usuarios de Internet como para periodistas en tiempos en los que probablemente no sepamos diferenciar qué es real y qué no.

Imagina a un país con una democracia no tan desarrollada como las modernas en el que se publica un vídeo completamente falso de uno de los opositores: esa persona podría ser condenada por hechos falsos. Por lo que necesitamos herramientas de fact-checking para combatir eso. No obstante, este tipo de tecnología a menudo usada para crear pánico gracias a imágenes falsas podría ser de gran ayuda en la detección temprana de tumores.

Assembler, o cómo detectar si una imagen es falsa

Nicolas Cage introducido en un cuerpo de una mujer gracias a un DeepFake

Se trata, en concreto, de Assembler, una aplicación de una de las incubadoras de Alphabet (la matriz de Google). A pesar de que en un futuro esta herramienta podría liberarse para ser usada por todo el mundo, por ahora está planteada para el uso por parte de periodistas. Y, de hecho, ya está siendo usada por varios medios como el francés Agence France-Presse o el mexicano Animal Político, entre otros.

No obstante, los desarrolladores afirman estar controlando, por el momento, quién tiene acceso a esta herramienta (cuyo uso podría también llegar a ser peligroso), siendo cautelosos además de si se le está dando un uso abusivo o no. Aún es un poco incierto, pero este tipo de aplicaciones podrían ser usadas para mejorar los deepfakes, por lo que se hace bien en controlar, de momento, quién tiene contro sobre ella.

Si bien es cierto que hay métodos manuales para comprobar imágenes falsas, se trata de métodos técnicos que no están al alcande de todas las personas. Se re quieren no solo conocimientos, sino también herramientas específicas. Assembler, en cambio, proporciona todo esto sin necesidad de un entrenamiento necesariamente profundo.

Cómo funciona Assembler, capaz de detectar deepfakes

Este algoritmo funciona, en concreto, mezclando varios tipos de sistemas de detección de fotos alteradas, detectáando varios tipos de modificaciones que pudieran haber sido realizadas. Además, gracias a que esta herramienta ha sido entrenada mediante el uso de otros algoritmos capaces de generar deepfakes, no solo es capaz de insinuar que una imagen ha sido alterada, sino también capaz de vislumbrar qué tipo de tecnología o método se ha empleado.

Comparando fotos de caras para aprender de las personas

Asimismo, y lo que es completamente novedoso (ya que se implementa todo al mismo tiempo), Assembler es capaz de aprender de fotos de personas para detectar fotos suyas modificadas.

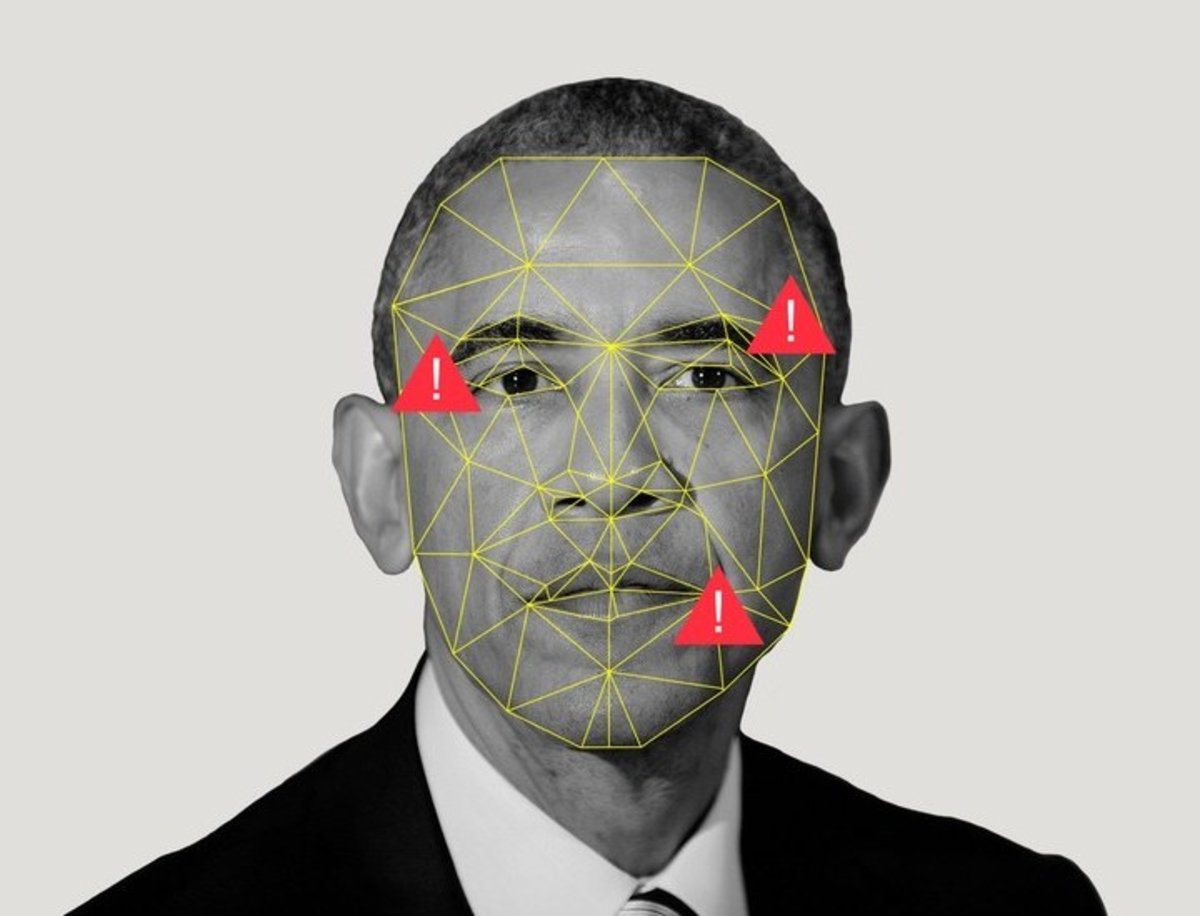

Obama es una de las personas que ha sido víctima de los vídeos deep fake. <a href="https://www.wired.com" rel="nofollow" target="_BLANK">Wired</a>

Es decir, es puede aprender los detalles de la cara de una persona gracias a una galería de fotos para posteriormente decidir si una foto supuestamente suya es real o no. La unión de estos métodos de detección es lo que precisamente hace a Assembler tan novedoso con respecto a otros sistemas individuales, pues incluso arroja resultados más precisos.

Pero lo reamente interesante es lo que el futuro nos depara: herramientas aún más inteligentes integradas en los propios motores de búsqueda como Google o YouTube que nos indique que algún contenido de la web o vídeo al que estemos entrando ha sido manipulado. Y esto ya está en desarrollo, en realidad. No hay más que recordar cómo Youtube ha puesto en marcha el desarrollo de una herramienta capaz de detectar vídeos falsos para avisar a sus usuarios, o directamente para bloquear dichos vídeos (aunque la delgada línea entre la censura y la protección a la verdad podría romperse en este último caso).